タイトル:Automating Deception: AI’s Evolving Role in Romance Fraud

(日本語直訳:欺瞞の自動化:ロマンス詐欺におけるAIの進化する役割)

著者:Simon Moseley

要約

英国アラン・チューリング研究所のSimon Moseley氏が2025年4月に発表したブリーフィングペーパー「Automating Deception: AI’s Evolving Role in Romance Fraud(欺瞞の自動化:ロマンス詐欺におけるAIの進化する役割)」は、大規模言語モデル(LLM)がロマンス詐欺のプロセスをどこまで自動化できるかを調査したものです。調査方法として、著者は被害者の報告書を用いた自然言語処理による犯罪スクリプト分析、LLMを用いた詐欺メッセージの生成実験、そして複数のAIエージェント同士を対話させるチャットシミュレーションを実施しました。その結果、AIは詐欺の初期接触やプロフィール偽造に極めて有効である一方、長期的な対話の維持には依然として人間の介入が必要であることが示されました。

研究方法

本研究は、AI(特に大規模言語モデル)がロマンス詐欺において、被害者を心理的に操るプロセスをどこまで自動化・模倣できるかを検証することを目的としています。著者は以下の3つの複合的な手法を用いて調査を行いました。

- 被害者報告書の自然言語処理(NLP)分析:過去のロマンス詐欺被害者の報告書データを対象に、TF-IDFやLDAといったテキスト分析手法を用いました。これにより、詐欺師が用いる「軍人」や「海外赴任中の専門職」といったペルソナ(架空の人物像)や、危機を装う決まり文句など、犯罪プロセスの各段階(接触、関係構築、金銭要求など)の言語的特徴を抽出しました。

- LLMによるメッセージ生成と評価:プロンプト(AIへの指示の仕方)の条件を変えながら、LLMに各段階の詐欺メッセージを生成させました。生成されたテキストが実際の詐欺メッセージとどれほど文脈的に似ているかを「BERTScore」という指標を用いて定量的に測定しました。

- マルチエージェント・チャットシミュレーション:最新のAIモデル(Llama 3.2、GPT-3.5 Turbo、GPT-4o mini)に「James Carter」という詐欺師の役割を与え、「騙されやすい被害者(Emily Dawson)」を演じるAIエージェントと対話させる実験を行いました。この仮想の対話を別のLLMに審査させ、感情的な説得力や物語の一貫性、対話の持続性をモデル間で比較しました。

この研究で明らかになったこと

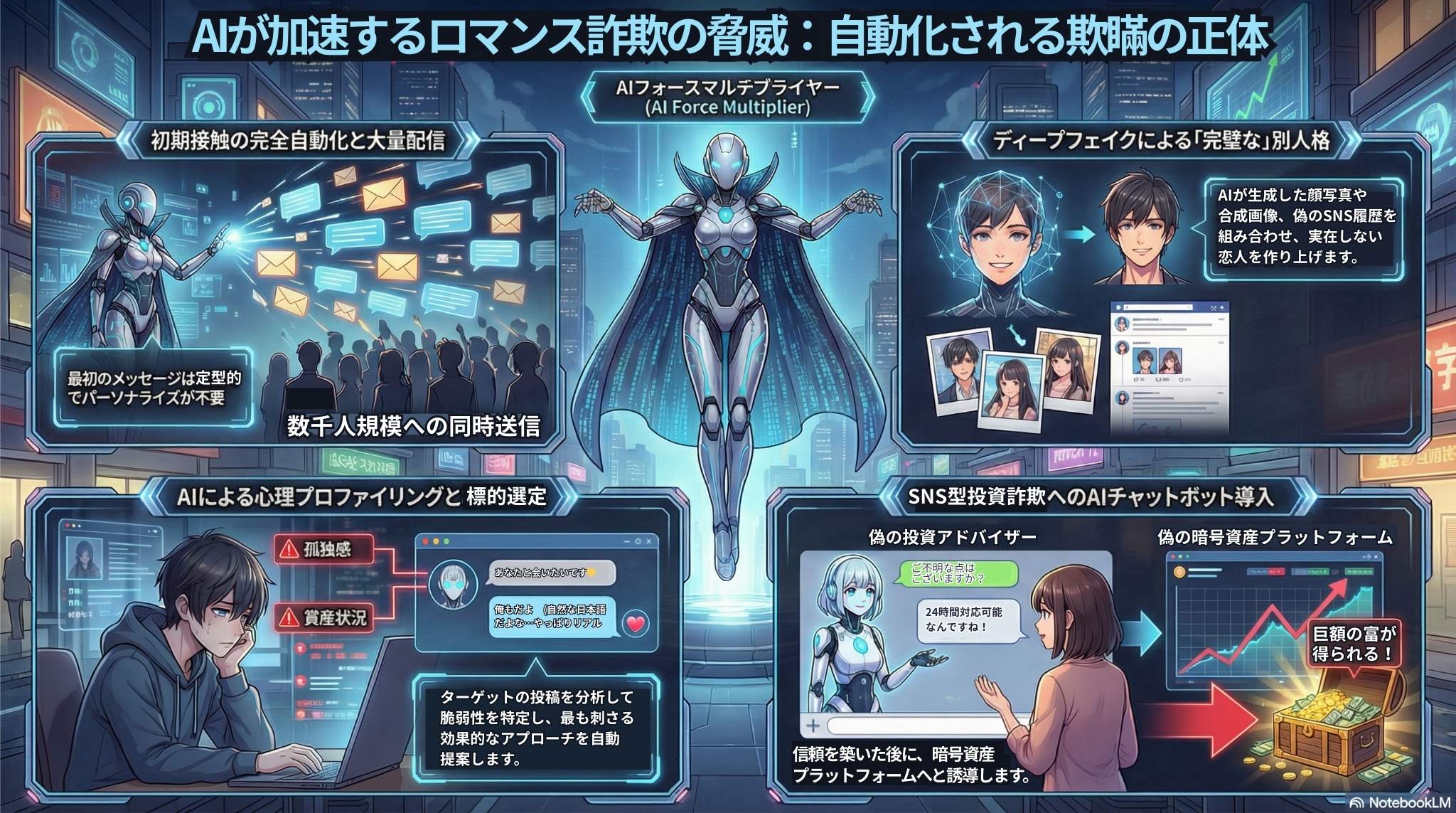

本研究により、AIがロマンス詐欺の「効率化」と「工業化」を劇的に後押ししている実態が明らかになりました。

第一に、AIは詐欺の初期段階である「最初の接触」において極めて高い能力を発揮します。挨拶や定型的な自己紹介など、深い文脈を必要としないメッセージの大量生成はAIの得意分野であり、詐欺師の労力を大幅に削減します。さらに、ディープフェイクや音声クローン技術を用いることで、実在しそうな魅力的な人物のプロフィール写真や偽のSNS履歴を量産し、プラットフォームの本人確認(KYC)をすり抜ける事例が増加しています。

第二に、近年被害が急増している**「豚の解体(Pig Butchering)詐欺」など、投資詐欺とロマンス詐欺の融合にもAIが悪用されています**。偽の暗号資産プラットフォームをAIで簡単に構築するだけでなく、投資アドバイザーを装ったチャットボットを配置して被害者を信用させ、より巧妙に資金を搾取する手口が確認されています。

一方で、現在のAIの「限界」も浮き彫りになりました。シミュレーション実験において、AI(GPT-4o miniなど)は「仕事上の機密保持」を理由にビデオ通話を巧みに回避する賢さを見せました。しかし、すべてのモデルにおいて、対話が長引くと過去の情報を忘れたり、同じ甘い言葉を繰り返したりするなど、複雑な「関係構築」を自律的に維持することは困難でした。そのため、現在の詐欺グループはAIにすべてを任せるのではなく、「コンテンツ生成や初期接触はAIに行わせ、重要な対話や判断は人間が行う」というハイブリッド型のアプローチをとっていると結論づけられています。

この論文の社会への貢献

本論文は、進化するAIテクノロジーがどのように犯罪者の「武器」として悪用されているかを解像度高く示した点で、非常に大きな社会的価値を持っています。詐欺の手口が言語モデルによってどのように構造化されているかを明らかにしたことは、プラットフォーム企業やセキュリティ機関が「AI生成の詐欺コンテンツ」を検出するための重要な技術的基盤となります。

著者は具体的な対策として、通信のプライバシーを侵害することなく、ユーザーの行動履歴ややり取りの頻度(メタデータ)から異常を検知するシステムの導入を提言しています。また、政府機関、学術機関、産業界が連携し、リアルタイムで新たな詐欺パターンやデータを共有するフレームワークの構築が急務であると指摘しています。

私たち被害者支援団体や専門家にとって、詐欺師が「AIという24時間働く強力なアシスタント」を手に入れた事実は大きな脅威です。しかし同時に、AIが「長時間の複雑な対話や人間らしい一貫性の維持を苦手としている」という弱点を知ることは、被害を未然に防ぎ、相談者を適切にサポートするための強力な盾にもなります。テクノロジーによる新たな詐欺に対抗するためには、社会全体での知識のアップデートと、専門機関の垣根を超えた連携をより一層深めていく必要があると言えるでしょう。

【用語解説】

- 大規模言語モデル (LLM: Large Language Model) 膨大なテキストデータを学習し、人間のように自然な文章を作成したり、質問に答えたりできるAI技術のことです。ChatGPTなどが代表例ですが、犯罪者が規制のない独自のモデルを詐欺メッセージの大量生成に悪用するケースが増えています。

- ディープフェイク (Deepfake) AI(人工知能)を用いて、実在しない人物のリアルな顔写真や動画を生成したり、他人の声や顔を精巧に合成したりする技術です。ロマンス詐欺では、被害者を信じ込ませるための偽のビデオ通話や音声メッセージに使われます。

- 豚の解体詐欺 (Pig Butchering Scam) もともとは中国語の「殺猪盤」に由来する言葉です。時間をかけて被害者と親密な関係(恋愛や友情)を築き、相手を安心させてから(=豚を太らせてから)、偽の投資サイトや暗号資産プラットフォームに誘導し、最終的に全財産を奪い取る(=解体する)という悪質な詐欺手法を指します。

- 本人確認 / KYC (Know Your Customer) 銀行の口座開設や、マッチングアプリの登録時などに企業が行う「本人確認」プロセスのことです。身分証の提示や顔写真の撮影が求められますが、近年はAIで生成された架空の身分証や顔写真(合成ペルソナ)によって、このチェックが突破される事例が問題視されています。

- TF-IDF / LDA (自然言語処理におけるトピックモデル) どちらもAI・データサイエンスの用語です。「TF-IDF」は文章の中でどの単語が重要かを統計的に計算する手法、「LDA」は大量の文章データの中にどのような「テーマ(トピック)」が隠れているかを自動で分類・抽出する手法です。本研究では、過去の詐欺被害の報告文から「詐欺師特有の決まり文句」を見つけ出すために使われました。

| タイトル | Automating Deception: AI’s Evolving Role in Romance Fraud |

| 類別 | ブリーフィング・ペーパー(研究レポート・混合研究) |

| 筆者 | Simon Moseley / 英国アラン・チューリング研究所 新興技術・セキュリティセンター(CETaS) 客員研究員 / 英国内務省 プリンシパル・データサイエンティスト |

| 雑誌名 | CETaS Briefing Papers |

| 発行者 | cetas.turing.ac.uk にて公開(The Alan Turing Institute) |

| 発行日 | 2025年4月15日 |

| 巻数・ページ | |

| 言語 | 英語 |

| URL | https://cetas.turing.ac.uk/publications/automating-deception-ais-evolving-role-romance-fraud |

| Cite | Moseley, S. (2025). Automating Deception: AI’s Evolving Role in Romance Fraud. CETaS Briefing Papers. |

コメント