Digital deception: generative artificial intelligence in social engineering and phishing(デジタル上の欺瞞:ソーシャルエンジニアリングとフィッシングにおける生成人工知能)

Marc Schmitt, Ivan Flechais

要約

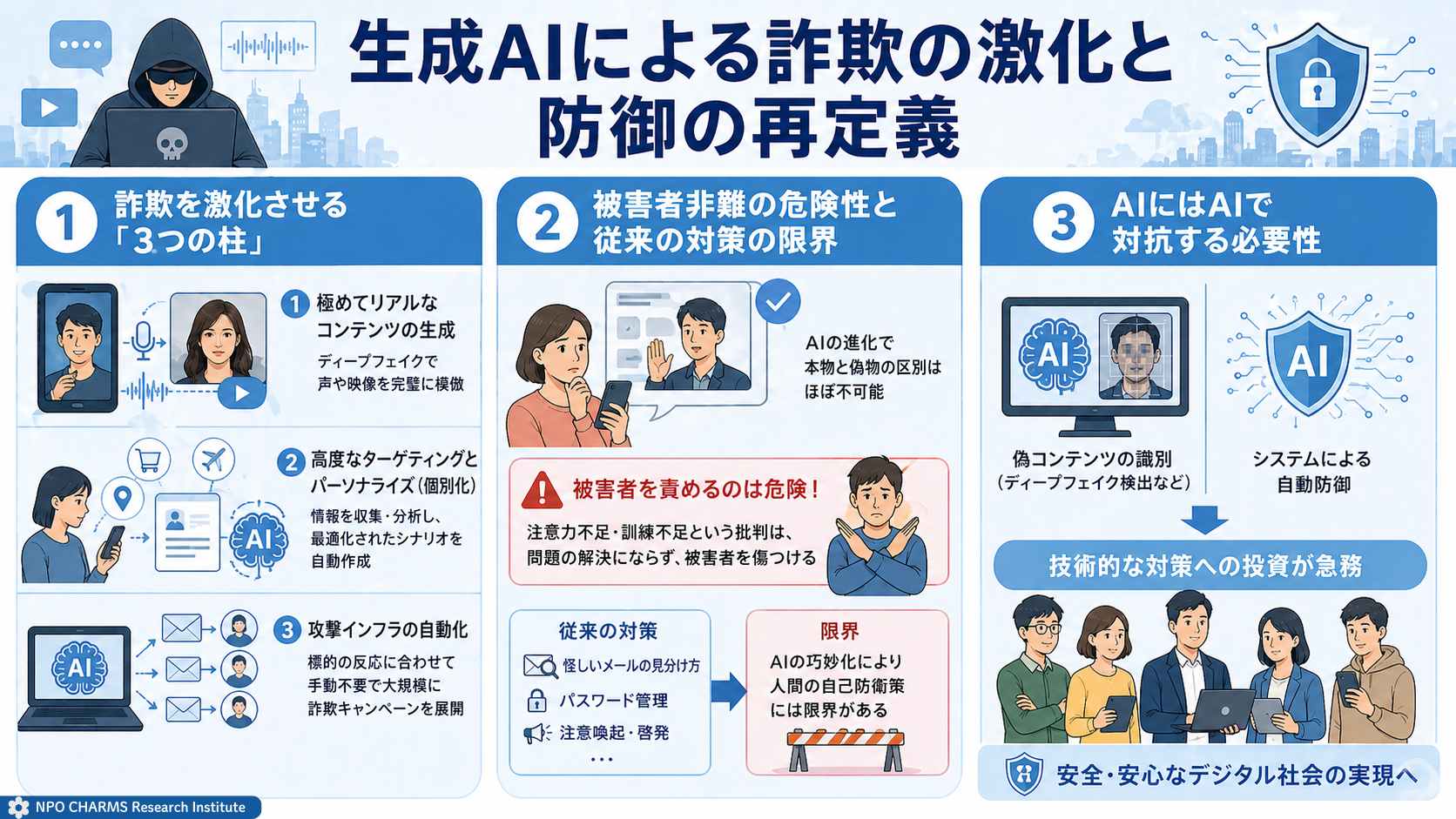

イギリスのオックスフォード大学コンピュータサイエンス学部のMarc Schmitt先生とIvab Flechais先生による研究論文「Digital deception: generative artificial intelligence in social engineering and phishing(デジタル上の欺瞞:ソーシャルエンジニアリングとフィッシングにおける生成AI)」は、生成AIがネット詐欺に与える影響を分析した研究です。本研究は、既存の文献の系統的レビューを通じて、生成AIが攻撃を激化させる3つの柱(リアルなコンテンツ生成、高度なターゲティング、攻撃の自動化)を特定しました。その結果、被害者を非難する従来の自己防衛頼りの対策の限界を学術的に指摘し、AI駆動型の新たな防御モデルの必要性を結論づけています。攻撃者側の視点から生成AIの脅威を体系化した点で画期的な研究と言えます。

研究方法

本研究は、生成AIがソーシャルエンジニアリング(人間の心理的隙を突く詐欺手法)やフィッシング詐欺をどのように巧妙化させているかを解明することを目的に行われました。

手法としては、質的分析である系統的レビューとフレームワークに基づく分析という論理的なアプローチを採用しています。ScopusやWeb of Scienceといった信頼性の高い学術データベースや、世界経済フォーラムなどの業界レポートから、ソーシャルエンジニアリングと生成AIに関する既存の研究や報告を網羅的に収集しています。収集したデータからAIの能力をテーマごとに分類し、既存のソーシャルエンジニアリングの理論と照らし合わせることで、生成AIが詐欺を激化させる要因を抽出しました。一般的なアンケート調査や統計(量的研究)のみに頼るのではなく、最新の技術動向や犯罪手法のメカニズムを理論的に解き明かし、独自の分析モデル(フレームワーク)を構築している点が本研究の大きな特徴です。

この研究でわかったこと

この研究では、生成AIが詐欺の脅威をかつてないレベルに引き上げる理由と、それに対する従来の対策の問題点が明確になりました。

詐欺を最強にさせる3つの柱

論文では、生成AIによる脅威を以下の3つの側面に整理しています。

- 極めてリアルなコンテンツの生成:AIは、本物の人間が書いたかのような自然な文章を作成するだけでなく、ディープフェイク技術を用いて実在の人物の声や映像を完璧に模倣します。これにより、被害者が相手を偽物だと見抜くことは非常に困難になります。

- 高度なターゲティングとパーソナライズ(個別化):AIはインターネット上に散らばるターゲットの趣味、所属、行動パターンなどの情報を瞬時に収集・分析し、その人に最適化されたオーダーメイドの詐欺シナリオを自動作成します。

- 攻撃インフラの自動化:AIを搭載したシステムを使えば、詐欺師は手動で作業することなく、標的の反応に合わせてリアルタイムにアプローチを変えながら、大規模な詐欺キャンペーンを全自動で展開することができます。

従来の対策の限界がもたらす被害者非難

この論文から導き出される最も重要な知見の一つは、怪しいメールを見分ける訓練といったユーザー側の自己防衛策には限界が来ているという点です。AIの進化により、本物と偽物の区別は人間の目ではほぼ不可能になりつつあります。論文では、詐欺被害に遭った人を注意力が足りなかった・訓練不足だったと責めるようなアプローチは、問題の解決にならないばかりか、被害者を不当に傷つける誤った論理(被害者非難)であると強く警鐘を鳴らしています。

AIにはAIで対抗する必要性

人間の注意力に頼るのではなく、AIが生成した偽コンテンツを識別する技術(ディープフェイク検出など)や、システムによる自動防御など、技術的な対策への投資が急務であることがわかりました。

この論文の社会への貢献

新たな脅威に対する共通理解の提供

この論文は、生成AIとサイバー犯罪という最新の脅威について、生成AIソーシャルエンジニアリング・フレームワークという分かりやすい青写真を提供しました。これにより、行政やセキュリティ専門家が現状のリスクを正しく評価し、今後の対策を立てるための共通言語が生まれたことは大きな社会的貢献です。

被害者支援の在り方の根本的な見直し

騙される側にも隙があるという古い認識を、学術的な視点から真っ向から否定したことは、極めて大きな意義を持ちます。詐欺被害は個人の不注意ではなく、高度に洗練されたテクノロジーによる犯罪的心理操作の結果です。この視点は、被害に遭って苦しむ方々の自責の念を和らげ、カウンセラーや支援団体がより適切で温かいケアを提供するための強力な根拠となります。

誰もが当事者となる時代に向けてのメッセージ

この論文が示すように、今日のデジタル社会では、どれほどITの知識がある人でも、AIを駆使した巧妙な罠に陥る可能性があります。だからこそ、私たちは被害に遭った人を決して孤立させず、社会全体でテクノロジーの悪用に対抗していく仕組みを構築しなければなりません。行政機関や警察はより高度なAI防犯技術への投資を、支援者は被害者に寄り添うケアの充実を、そして私たち一般市民は「誰もが騙されうる」という前提に立った寛容な社会づくりを意識することが求められます。他人事ではなく、明日の私たちの安全と尊厳を守るための、重要な一歩となる研究です。

用語解説

- ソーシャルエンジニアリング (Social Engineering):システムやネットワークの技術的な弱点ではなく、人間の心理的な隙や行動のミス(信頼感や恐怖心など)を突いて、機密情報やパスワードなどを騙し取る手法の総称です。

- フィッシング (Phishing):実在する企業や公的機関、あるいは知人を装った電子メールやSMSなどを送りつけ、偽のウェブサイトに誘導してパスワードやクレジットカード情報などの個人情報を入力させる詐欺手法のことです。

- 生成AI (Generative AI):大量のデータを学習し、文章、画像、音声、動画などの新しいオリジナルコンテンツを自動的に作り出すことができる人工知能のこと。

- ディープフェイク (Deepfake):AIの深層学習技術を用いて、実在の人物の顔や声を合成し、あたかもその人が本当に話したり行動したりしているかのような、極めて精巧な偽の動画や音声を作成する技術です。

- 系統的レビュー (Systematic Review):過去に行われた多数の研究や文献を、あらかじめ決めた厳密なルールに従って網羅的に収集・分析し、偏りのない客観的な結論を導き出す研究手法です。

| タイトル | Digital deception: generative artificial intelligence in social engineering and phishing(デジタル上の欺瞞:ソーシャルエンジニアリングとフィッシングにおける生成人工知能) |

| 論文の種類 | ジャーナル論文 |

| 論文の分野 | 情報セキュリティ、犯罪学、心理学 |

| 著者 | Marc Schmitt, Ivan Flechais(イギリス オックスフォード大学 コンピュータサイエンス学部) |

| 論文誌名・発行者 | Springer Nature (Artificial Intelligence Review) |

| 発行日・巻数・ページ | 発行日: 2024年10月12日 (Accepted: 24 September 2024)、巻数: 57、ページ: 324 |

| 原著論文の言語 | 英語 |

| URL | https://link.springer.com/article/10.1007/s10462-024-10973-2 |

| Cite | Schmitt, M., & Flechais, I. (2024). Digital deception: generative artificial intelligence in social engineering and phishing. Artificial Intelligence Review, 57(324). https://doi.org/10.1007/s10462-024-10973-2 |

コメント