From ChatGPT to ThreatGPT: Impact of Generative AI in Cybersecurity and Privacy(ChatGPTからThreatGPTへ:サイバーセキュリティとプライバシーにおける生成AIの影響)

Maanak Gupta, Charankumar Akiri, Kshitiz Aryal, Eli Parker, Lopamudra Praharaj

要約

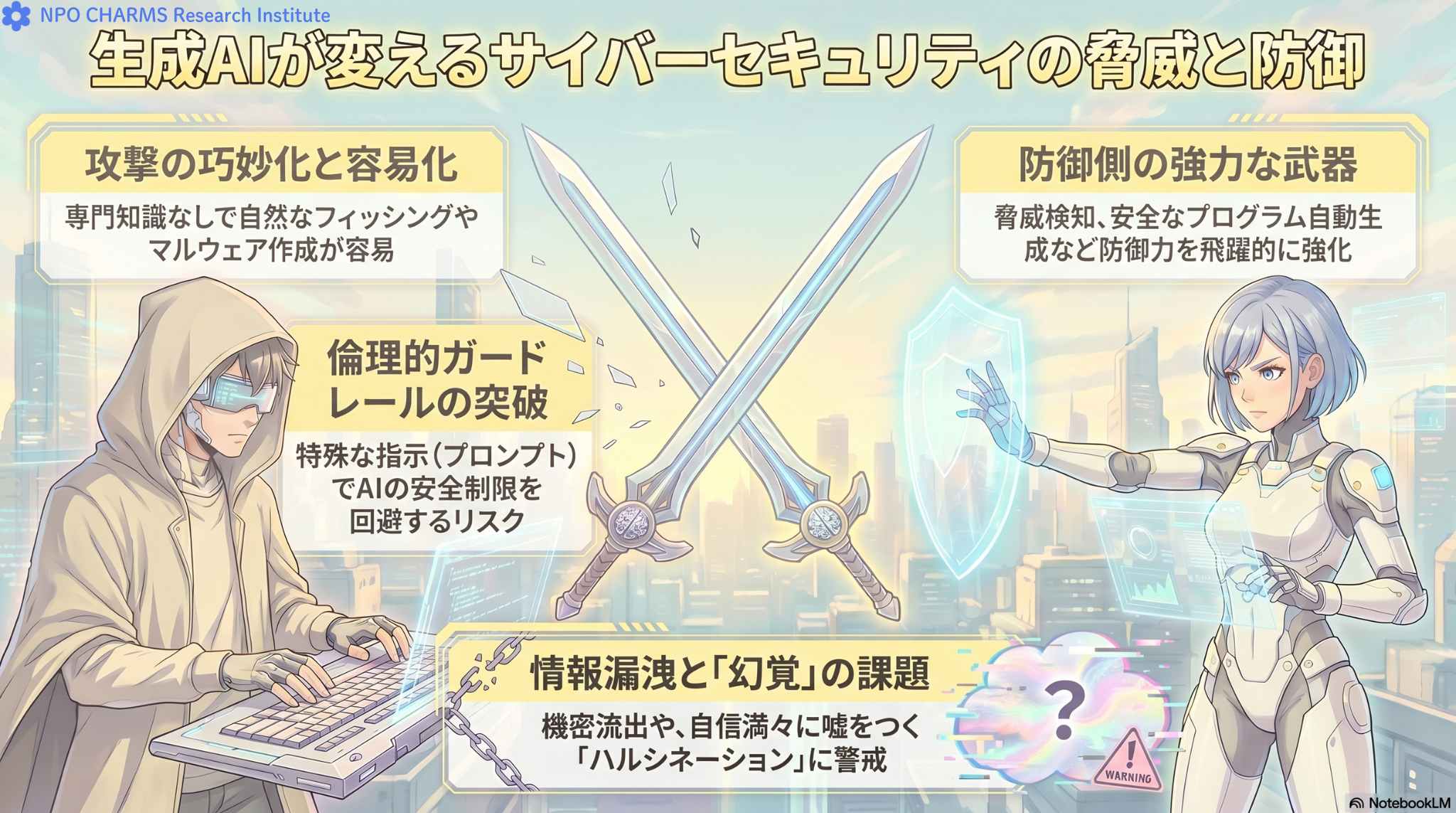

米国テネシー工科大学のMaanak Gupta博士らによる研究論文「From ChatGPT to ThreatGPT: Impact of Generative AI in Cybersecurity and Privacy(ChatGPTからThreatGPTへ:サイバーセキュリティとプライバシーにおける生成AIの影響)」は、ChatGPTに代表される生成AIがサイバーセキュリティとプライバシーに与える影響を検証しています。本研究では、ChatGPTを実際の攻撃・防御のシナリオでテストする実験を行いました。その結果、攻撃者はジェイルブレイクなどの手法でAIの倫理的制約を回避し、マルウェア作成や高度な詐欺文面を生成できることが判明しました。一方で、AIはサイバー防御の自動化や脅威の検出にも極めて有用であることも確認されています。結論として、生成AIはセキュリティにおいて「諸刃の剣」であり、安全で信頼できるデジタル環境を構築するためには、AIの脆弱性への対策や新たな防衛手段の確立が急務であると警鐘を鳴らしています。

研究方法

本研究は、生成AI(主にChatGPTのGPT-3.5モデルなど)を対象に、実際のシステム上で様々な指示(プロンプト)を与え、どのような応答が返ってくるかを観察・分析する実験的手法を用いています。通常の利用ではAIが回答を拒否するように設定されている悪意のあるコード(例:コンピュータウイルスや、データを人質に取るランサムウェアなど)の作成を、特殊な会話テクニックを用いて引き出せるかを検証しました。また、サイバー空間を守る防御の観点からも、攻撃の痕跡を見つけるためのシステムログデータの解析や、脆弱性のあるプログラムを修正する安全なコードの提案が可能かどうかなど、多角的なテストが行われました。

この研究でわかったこと

攻撃の手口が極めて巧妙化・容易化するリスク

研究により、AIを利用することで、高度な専門知識がなくても、コンピュータシステムを攻撃するコードの生成やシステムの弱点を突く手順の自動化ができてしまうことが明らかになりました。特に、本物そっくりのフィッシングメールや、相手の心理を巧みに操るソーシャルエンジニアリングと呼ばれる詐欺において、個別のターゲットに合わせた非常に説得力のある文章がAIによって簡単に作成されてしまうことが確認されています。

AIの倫理的ガードレールを突破される危険性

ChatGPTには本来、悪用を防ぐための倫理的な制約がプログラムされていますが、攻撃者はジェイルブレイク(脱獄)やプロンプトインジェクションといった特殊な手法を使うことで、この制約をすり抜けてしまうことがわかりました。例えば、AIではなく、何でもできるキャラクターを演じてと指示するだけで、危険な情報が引き出されてしまうケースが実証されています。

防御側にとっての強力な武器としての可能性

一方で、AIはサイバー攻撃から身を守るための強力なツールにもなります。AIに大量のシステムログを読み込ませることで、攻撃の兆候を瞬時に検出し、セキュリティ担当者に警告を出すことが可能です。また、サイバー攻撃が発生した際の初期対応の手順を自動生成し、被害を最小限に食い止めるための助言を行うなど、防御側の負担を大きく軽減し、より強固な対策を構築できる可能性も示されました。

情報漏洩や「もっともらしい嘘(幻覚)」という課題

AIが学習したデータに企業の機密情報や個人のプライバシー情報が含まれていた場合、それが他のユーザーへの回答として漏洩してしまうリスクが指摘されています。また、AIが事実とは異なる情報を自信満々に生成してしまうハルシネーション(幻覚)という現象もあり、攻撃者がこれを悪用して罠を仕掛ける危険性も明らかになりました。

この論文の社会への貢献

「騙される方が悪い」という認識の転換と被害者支援

本論文は、AIの進化によってサイバー攻撃やオンライン詐欺がかつてないほど巧妙化し、個々人の状況に合わせてパーソナライズされていることを科学的に示しました。これは、「騙される方が悪い」「不注意だったからだ」という従来の被害者非難(ヴィクティム・ブレイミング)を明確に否定する重要な根拠となります。AIが作成した本物と見分けがつかないメッセージの前では、どんなに気をつけていても誰もが被害に遭う可能性があります。この知見は、被害に遭われた方の自責の念を和らげ、心理的ケアやカウンセリングにおいて極めて重要な視点を提供します。

すべてのステークホルダーに対する防衛への道標

この研究は、技術者や研究者だけでなく、行政、警察機関、支援者、そして一般市民の皆様にとっても大きな意義があります。行政や警察は、最新のテクノロジーを悪用した犯罪のメカニズムを深く理解し、より実効性の高い法整備や捜査手法の確立、国民への啓発活動に役立てることができます。また、私たち一人ひとりが現在の生成AIにはこのような悪用リスクがあると知ることは、デジタル社会を安全に生き抜くための大切な第一歩です。テクノロジーの光と影を正しく理解し、社会全体で被害を防ぎ、被害に遭われた方に温かく寄り添う環境を作っていくための確かな土台となる研究です。

用語解説

- 生成AI(GenAI):テキスト、画像、音声、プログラムコードなど、新しいコンテンツを自動的に生成することができる人工知能システムのことです。ChatGPTもその代表例です。

- ソーシャルエンジニアリング:人間の心理的な隙や不注意に付け込み、パスワードなどの機密情報を聞き出したり、詐欺的な行動を取らせたりする手口のことです。

- ランサムウェア(Ransomware):感染したコンピュータのデータを暗号化して使えなくし、元に戻すことと引き換えに身代金(ランサム)を要求する悪意のあるプログラムです。

- フィッシング(Phishing):実在する企業などを装った偽の電子メールやウェブサイトを用いて、クレジットカード番号やログインIDなどの個人情報を盗み出す詐欺の手口です。

- ジェイルブレイク(Jailbreak / 脱獄):本来のシステム開発者が設定した安全上の制限や倫理的なルールを、特殊な会話手法などで解除・回避し、通常は許可されていない回答を引き出すことです。

- プロンプトインジェクション:AIへの入力文(プロンプト)の中に、AIを騙したり誤動作させたりするための悪意のある命令をこっそり忍び込ませる手法です。

- ハルシネーション(幻覚):AIが、まるで真実であるかのように、全くの嘘やでたらめな情報を生成してしまう現象のことです。

| タイトル | From ChatGPT to ThreatGPT: Impact of Generative AI in Cybersecurity and Privacy(ChatGPTからThreatGPTへ:サイバーセキュリティとプライバシーにおける生成AIの影響) |

| 論文の種類 | ジャーナル論文 |

| 論文の分野 | サイバーセキュリティ、情報工学 |

| 著者 | Maanak Gupta, Charankumar Akiri, Kshitiz Aryal, Eli Parker, Lopamudra Praharaj(米国 テネシー工科大学 コンピュータサイエンス学部) |

| 論文誌名・発行者 | IEEE (ジャーナル名:IEEE Access) |

| 発行日・巻数・ページ | 2023年8月1日 発行(デジタルオブジェクト識別子発行) |

| 原著論文の言語 | 英語 |

| URL | https://ieeexplore.ieee.org/document/10198233 |

| Cite | Gupta, M., Akiri, C., Aryal, K., Parker, E., & Praharaj, L. (2023). From ChatGPT to ThreatGPT: Impact of Generative AI in Cybersecurity and Privacy. IEEE Access. https://doi.org/10.1109/ACCESS.2023.3300381 |

コメント