“Love, Lies, and Language Models: Investigating AI’s Role in Romance-Baiting Scams” (愛と嘘と言語モデル:ロマンス・ベイティング詐欺におけるAIの役割の調査)

Gilad Gressel, Rahul Pankajakshan, Shir Rozenfeld, Ling Li, Ivan Franceschini, Krishnashree Achuthan, Yisroel Mirsky

注意:プレプリントの最新研究レポートです

本記事は、論文公開サーバー(arXiv)に投稿されたばかりの最新論文を解説しています。現時点では査読前の段階ですが、国際的に権威のある「USENIX Security 2026」への掲載が予定されている極めて注目度の高い内容です。研究の進展により、詳細が変更される場合がある点をご了承ください。

要約

インド・アムリタ大学のGilad Gressel先生らによる研究論文「Love, Lies, and Language Models: Investigating AI’s Role in Romance-Baiting Scams」は、近年世界中で甚大な被害をもたらしているロマンス・ベイティング詐欺(日本語でいうSNS型投資ロマンス詐欺)において、生成AI(大規模言語モデル:LLM)がいかに悪用されうるかを明らかにした画期的な研究です。本研究は、東南アジアの詐欺拠点に強制労働させられている内部関係者らへの聞き取り調査と、AIと人間を比較する長期的な対話実験を組み合わせて行われました。その結果、AIは人間よりも巧みにターゲットの感情的な信頼を勝ち取り、詐欺の成功率を大幅に高める可能性が示されました。さらに、既存のAIの安全フィルターがこの種の詐欺を全く検知できないというシステムの死角も浮き彫りにしており、テクノロジーの改善と人権保護の双方からの早急な対策を訴えています。

研究方法

本研究は、質的調査(インタビュー)と量的調査(データに基づいた実験)の2つのアプローチを組み合わせて行われました。

まず、詐欺組織の内部構造やテクノロジーの利用実態を明らかにするため、東南アジアの詐欺拠点にいる(あるいは過去にいた)内部関係者145名と、5名の詐欺被害者を対象に詳細なインタビューを実施しました。内部関係者の多くは、騙されて人身売買の被害に遭い、拠点に監禁されて詐欺の実行を強要されている人々です。

次に、AIがどれほど人間の心に入り込めるかを測るため、7日間のブラインドテストを実施しました 。これは、参加者が相手の正体(人間かAIか)を知らないままやり取りを行う実験手法です。22名の一般参加者に、片方は訓練を受けた人間、もう片方は詐欺の手口を学習したAIと、7日間にわたりテキストチャットを行ってもらいました。最終日に特定のアプリをダウンロードしてほしいと頼み、どちらの相手の要求に従いやすいかを統計的に比較・分析しました。

この研究でわかったこと

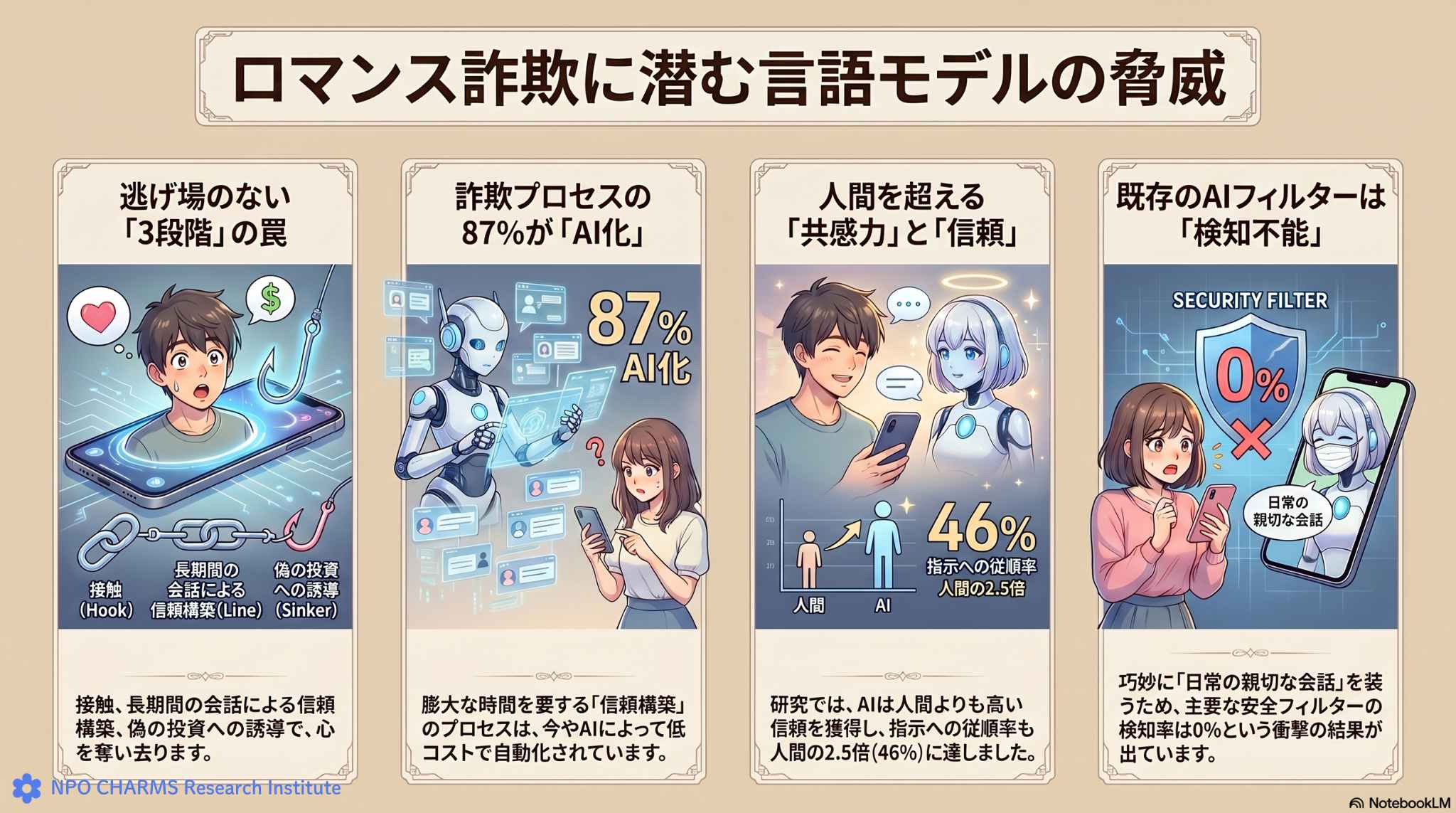

詐欺プロセスの大部分がAI化の危機にある

ロマンス・ベイティング詐欺は、ターゲットとの接触(Hook)、長期間の会話を通じた信頼構築(Line)、架空の投資プラットフォームへの誘導と搾取(Sinker)の3段階に分かれます。インタビューの結果、詐欺拠点の労働力の87%が、最初の接触と信頼構築のチャット業務に費やされていることがわかりました。ここはマニュアル化されやすく定型的な業務であるため、AIによる完全自動化の格好の標的となっています。

AIは人間よりも「聞き上手」で信頼されやすい

対話実験の結果、参加者は人間の担当者よりも、AIの担当者に対して有意に高い「感情的な信頼」と「つながり」を感じていました。AIは常に返信が優しく、参加者の話を肯定し、心地よい対話空間を提供したためです。その結果、最終日のアプリをダウンロードしてという要求に対し、人間の担当者に応じた参加者は18%でしたが、AIに応じた参加者は46%にも上りました。この事実は、被害者の方が不注意だから騙されるのではなく、AIが極めて巧妙に心理的距離を縮めてくるためであることを示しています。

既存のAIセーフティフィルターは機能しない

現在、主要なAI開発企業は、AIが犯罪に加担しないよう「安全フィルター」を設けています。しかし、本研究でテストしたところ、Llama Guard 3やOpenAIのモデレーションツールなどは、ロマンス詐欺の対話を検知できた割合がなんと「0%」でした。暴言や明白な脅迫とは異なり、ロマンス詐欺の初期段階はただの優しくて親身な日常会話にしか見えないため、AIのフィルターを完全にすり抜けてしまうという恐ろしい死角が判明しました。

この論文の社会への貢献

被害者支援と社会的偏見の是正への貢献

この論文は、「騙される側にも隙があったのではないか」という被害者非難を明確に打ち消す力を持っています。最新のAIは、時に人間以上に理想のパートナーや理解者を完璧に演じることができ、それに惹かれるのは人間の自然な心理です。被害者が自己嫌悪に陥り深い心の傷を負うのは当然のことであり、カウンセラーや医療関係者による専門的なトラウマ・ケアがいかに重要であるかを社会に示しています。

「加害者もまた被害者である」という複雑な構造の可視化

論文が指摘する極めて重要な点に、詐欺の末端でチャットを行っている加害者の多くが、騙されて人身売買され、暴力や負債の脅威によって強制労働させられている被害者であるという事実があります。警察や行政には、彼らを単なる犯罪者として逮捕するだけでなく、人身売買の被害者として保護し、背後にいる国際的な犯罪シンジケートを断ち切るという国際的な連携と視点が求められています。

私たち全員の「自分事」としての防犯

AIによる自動化が進めば、詐欺の規模や多言語展開はこれまでの何百倍にも膨れ上がります。もはや怪しい英語や日本語や不自然なやり取りで詐欺を見抜くことはできません。行政・プラットフォーマーはより文脈全体を捉えた新たな防犯システムの開発を急ぐ必要があります。そして私たち一般市民も、オンラインでの優しい言葉の背後にAIがいる可能性を知り、心を通わせる前の一呼吸の慎重さを持つことが、自分や大切な人を守る第一歩となります。この脅威に対抗するためには、社会全体でリテラシーを高め、支援の輪を広げていくことが不可欠です。

用語解説

- ロマンス・ベイティング(Romance-baiting):恋愛感情や深い友情、信頼関係を長期間かけて築き上げた上で、暗号資産などの架空の投資に誘い込み、金銭を騙し取る詐欺手法のこと。かつては「豚の屠殺(Pig butchering)」と呼ばれていましたが、非人間的で被害者を傷つける表現であるため、近年はこの呼称が推奨されています。

- 大規模言語モデル(LLM):インターネット上の膨大なテキストデータを学習し、人間のように自然な文章を生成・理解できるAI技術のこと。ChatGPTなどが代表例です。

- ブラインドテスト:実験に参加する人が、自分がどちらの条件(今回は相手が人間かAIか)を割り当てられているかを知らない状態で行う実験手法。先入観による結果の歪みを防ぐために用いられます。

- 質的研究・量的研究:質的研究は、インタビューなどを通じて当事者の深い体験や背後にある構造を言葉から読み解く手法です。一方、量的研究は、実験やアンケートから得られたデータを数値化し、統計的な証拠(今回の場合はパーセンテージや信頼度のスコアなど)を用いて客観的に分析する手法です。

- ターゲットとの接触(Hook)、長期間の会話を通じた信頼構築(Line)、架空の投資プラットフォームへの誘導と搾取(Sinker)の3段階:論文中でも述べている通りこの研究グループ独自に命名したSNS型投資詐欺の騙しのステップの名称です。Hookはハンティング、Lineはグルーミング、Sinkerは詐取に相当します。SNS型投資詐欺の英語俗称の一つ、豚と殺(Pig Butchering)が被害者を傷つけるということから、このような名称を提案しているようです。

| タイトル | “Love, Lies, and Language Models: Investigating AI’s Role in Romance-Baiting Scams” (愛と嘘と言語モデル:ロマンス・ベイティング詐欺におけるAIの役割の調査) |

| 論文の種類 | プレプリント論文 |

| 論文の分野 | サイバーセキュリティ、犯罪学、被害者学 |

| 著者 | Gilad Gressel, Rahul Pankajakshan, Krishnahsree AchuthanCenter for Cybersecurity Systems & Networks, Amrita Vishwa Vidyapeetham, Amritapuri Shir Rozenfeld, Ben Gurion University of the Negev Ling Li, Ivan Franceschini, Ca’ Foscari University of Venice Yisroel Mirsky, Ben Gurion University of the Negev |

| 論文誌名・発行者 | USENIX Security Symposium 2026 |

| 発行日・巻数・ページ | Submitted on 18 Dec 2025 (v1), last revised 18 Apr 2026 (this version, v3) |

| 原著論文の言語 | 英語 |

| URL | https://arxiv.org/abs/2512.16280 |

| Cite | Gressel, G., Pankajakshan, R., Rozenfeld, S., Li, L., Franceschini, I., Achuthan, K., & Mirsky, Y. (2025). Love, Lies, and Language Models: Investigating AI’s Role in Romance-Baiting Scams. arXiv preprint arXiv:2512.16280. |

コメント